Crear un coche que conduzca solo requiere diseñar un coche capaz de pensar. Y eso, es casi imposible. En el mundo convencional, ahí acabaría el razonamiento y la esperanza de lograrlo. Sin embargo, el mundo de los microprocesadores lleva años afrontando este tipo de problema de una forma muy audaz. Si es casi imposible… basta con construir un ordenador que procese a una velocidad casi infinita. Por ej., a finales de los 90, cuando se prohibieron las pruebas nucleares, EE.UU. necesitaba resolver un problema casi imposible si querían seguir mejorando las cabezas nucleares. Necesitaban simular reacciones en cadena, calculando los efectos de cada una de las colisiones de neutrones y protones. De forma que construyeron un ordenador y le pusieron un nombre ´chulo´: ASCI Red. Como utilizaron 10.000 procesadores Pentium conectados en paralelo, ASCI Red ocupaba una planta de un edificio y consumía la electricidad de un barrio. Pero lo importante era que lograba realizar un millón de millones de cálculos por segundo… que es lo que hace falta para simular una explosión nuclear o para que un coche entienda el mundo que el rodea.

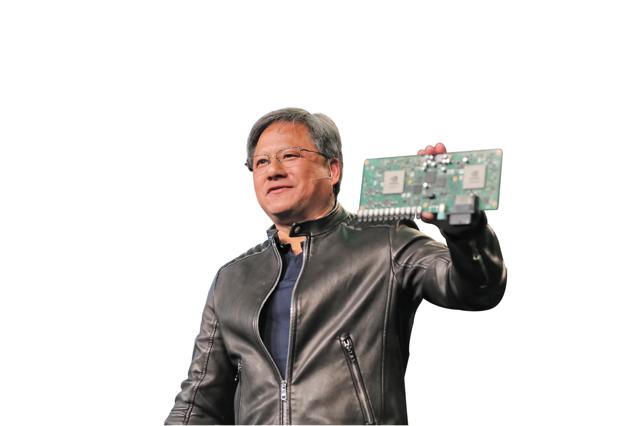

De manera que, el único problema de cara a implementar la conducción autónoma es reducir ASCI Red a un tamaño portátil. Pues bien, la placa integrada que sostiene el presidente de Nvidia, Jen-Hsun Huang, no contiene un ASCI Red… sino dos. Están reducidos a esos dos procesadores Nvidia Tegra X1. Y cada uno es capaz de realizar 1,3 TeraFLOPS. Para hacernos una idea, eso es mil veces más de lo que tradicionalmente se exige para denominar a algo ´supercomputadora´. Bien… ¿y de qué son capaces dos X1 funcionado en paralelo?

800 km… sin tocar el volante: Qué conduzca Jack

Jack es el apodo cariñoso que le ha puesto Audi al A7 Sportback, que ha recorrido de forma autónoma 800 km de autopista norteamericana. Ha circulado desde Silicon Valley hasta la legendaria ciudad de los casinos, a 110 km/h –velocidad máxima en las autopistas yankees–con periodistas a bordo y sin incidencias conocidas. Bueno, no parece para tanto…

Y no lo es. Jack no tiene, desde luego, una habilidad para conducir deslumbrante. Al fin y al cabo, 110 km/h no parece una velocidad muy alta, y lo único que sabe hacer Jack es ajustar su velocidad, cambiar de carril sin llevarse a nadie por delante y, de vez en cuando, tomar algunas decisiones relativamente complejas, como por ejemplo al llegar a bifurcaciones. Y siempre con la tranquilidad de poder apretar el botón del pánico y solicitar la asistencia del conductor humano que le supervisa. ¿Por qué tanto revuelo?

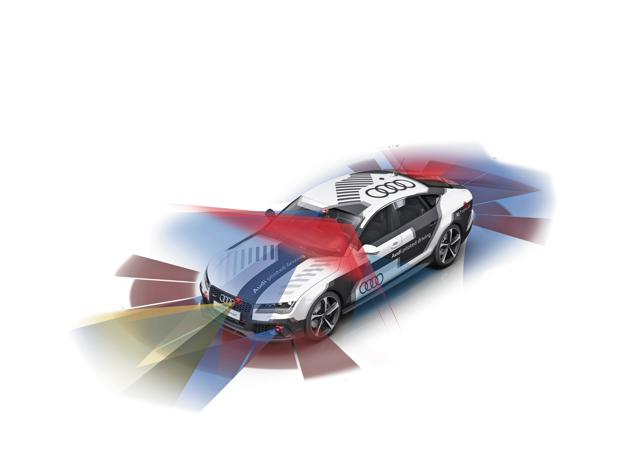

Porque Jack no es muy listo… pero tampoco es muy caro. Con matices, claro. Parte de los sensores de Jack son convencionales –es decir, razonablemente baratos–. Por ejemplo, cuenta con un radar frontal, dos radares delanteros y dos radares traseros de corto alcance y una cámara similares a los que Audi usa actualmente en sus sistemas ACC, Lane Assist y Side Assist. Además, incluye una cámara frontal estereoscópica de alta resolución parecida a la que va a montar el Audi Q7 y cuatro cámaras que proporcionan visión periférica. Todo va conectado al zFAS –el ordenador que ves arriba, movido por un Tegra K1, un procesador bastante más lento que el X1–, que va montado en el maletero. Además, Audi ha incorporado dos escáneres láser –uno delantero, en la parrilla y otro trasero, bajo el paragolpes– realmente caros… pero que no son imprescindibles. Según Audi, sólo están ahí por «plausibilidad» –traducido del alemán significa «no nos fiamos mucho de las redes neuronales»–.

Porque Jack no es muy listo… pero tampoco es muy caro. Con matices, claro. Parte de los sensores de Jack son convencionales –es decir, razonablemente baratos–. Por ejemplo, cuenta con un radar frontal, dos radares delanteros y dos radares traseros de corto alcance y una cámara similares a los que Audi usa actualmente en sus sistemas ACC, Lane Assist y Side Assist. Además, incluye una cámara frontal estereoscópica de alta resolución parecida a la que va a montar el Audi Q7 y cuatro cámaras que proporcionan visión periférica. Todo va conectado al zFAS –el ordenador que ves arriba, movido por un Tegra K1, un procesador bastante más lento que el X1–, que va montado en el maletero. Además, Audi ha incorporado dos escáneres láser –uno delantero, en la parrilla y otro trasero, bajo el paragolpes– realmente caros… pero que no son imprescindibles. Según Audi, sólo están ahí por «plausibilidad» –traducido del alemán significa «no nos fiamos mucho de las redes neuronales»–.

Pero la solución presentada por Nvidia en el CES, basada en el X1 –sucesor del K1–, y que se apoya en doce cámaras de alta definicion en lugar de emplear tantos sensores caros, parece bastante fiable. Ellos aseguran que el sistema se aclimató a Las Vegas en un par de semanas, y ofrecieron una demostración en directo bastante convincente. Y sí, esperan hacerse ricos vendiéndolos.

Probablemente lo consigan, porque no es la primera vez que un proveedor da el salto del anonimato a la fama gracias a un producto de calidad deslumbrante… y la trayectoria de Nvidia recuerda a la de la alemana ZF y sus cajas de cambio. La instrumentación de Audi, BMW, Mini, Tesla, Volkswagen y otras se basa en el Visual Computing Module, predecesor del K1. Sin duda, el X1 dará que hablar en los próximos años…

La red neuronal y la teracomputadora

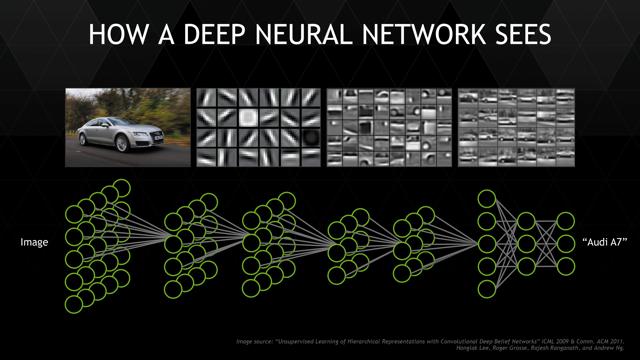

Pues, tal como ha demostrado Nvidia en el CES, dos X1 son capaces de ver mejor que una persona… entendiendo por ver mejor que es más fiable que tú o yo a la hora de interpretar qué es eso que asoma por detrás de un coche aparcado a los lejos en una de las fotos borrosas que componen un test de percepción muy usado en la industria. Y lo mejor de todo, es que esos procesadores no han sido programados: han aprendido a ver solitos. Les han enseñado. Entrenado. La clave reside en las ´redes neuronales´. Es una forma de computación que emplea ordenadores convencionales pero que toma decisiones de una forma particular, que trata de imitar el funcionamiento de los sistemas nerviosos de los seres vivos. La particularidad de las redes neuronales es su capacidad de aprender por repetición. Por ejemplo, es posible enseñar a una red neuronal a reconocer semáforos enseñándole muchas fotos de semáforos, preguntándole qué está viendo y dejando que se equivoque y que realice pequeños cambios en su programación antes de volver a intentarlo. De esta forma, las redes neuronales van afinando progresivamente su programación y respondiendo cada vez con mayor probabilidad de acierto.

Esta tecnología se aplica desde hace tiempo a la identificación de objetos en fotografías, pero debido al enorme coste computacional que tiene tanto el entrenamiento como la ejecución de estas redes, solían ser una curiosidad restringida al laboratorio y a aplicaciones muy especiales, como el diagnóstico por imagen de enfermedades. Hasta ahora. Dentro de cinco años, los coches con un par de Nividia Tegra X1 en el maletero van a conducir solos… y las accioners de Nvidia van a haber multiplicado su valor por cinco. El año pasado, subieron un 20%. ¿Te apuestas algo?

Síguenos en redes sociales

Síguenos en nuestras redes X, Facebook, TikTok e Instagram, o en nuestro canal de YouTube donde te ofrecemos contenidos exclusivos. Y si te apuntas a nuestra Newsletter recibirás las noticias más destacadas del motor.

Recibe nuestras noticias más recientes en tu correo

Te enviamos nuestra Newsletter cada semana con contenido destacado